CES | 엔비디아 아이작 플랫폼, 더욱 스마트한 로봇 구현하는 생성형 AI 지원

엔비디아(www.nvidia.co.kr)가 CES 2024를 앞두고 진행된 특별 연설에서 엔비디아(NVIDIA)와 파트너들이 생성형 AI와 로보틱스를 결합해 나가는 방식에 대해 자세히 설명했다.

보스턴 다이내믹스(Boston Dynamics), 콜래보레이티브 로보틱스(Collaborative Robotics), 코베리언트(Covariant), 생츄어리 AI(Sanctuary AI), 유니트리 로보틱스(Unitree Robotics) 등 점점 더 많은 파트너가 GPU 가속 대규모 언어 모델(LLM)을 채택하고 있다. 이로써 각종 기계에 전례 없는 수준의 지능과 적용성을 제공할 수 있다.

이처럼 생성형 AI가 수조 달러 규모의 산업을 재편해 나가는 가운데, 스마트 로보틱스 분야의 선두주자인 엔비디아는 이 기회를 적극 활용하고 있다.

엔비디아 로보틱스와 엣지 컴퓨팅 부문 부사장인 디푸 탈라(Deepu Talla)는 “AI 기반 자율 로봇이 효율성 향상, 비용 절감, 노동력 부족 문제 해결을 위해 점점 더 많이 활용되고 있다”고 말했다.

창조의 현장으로

엔비디아는 생성형 AI 혁명의 초기부터 그 중심에 있었다.

10년 전, 엔비디아 창립자 겸 CEO인 젠슨 황(Jensen Huang)은 최초의 엔비디아 DGX AI 슈퍼컴퓨터를 오픈AI(OpenAI)에 직접 전달했다. 오늘날 오픈AI의 챗GPT(ChatGPT) 덕분에 생성형 AI는 우리 시대에서 가장 빠르게 성장하는 기술 중 하나가 됐다.

그러나 이것은 시작에 불과하다.

탈라는 앞으로 생성형 AI의 영향력이 텍스트와 이미지 생성을 넘어 가정과 사무실, 농장과 공장, 병원과 실험실로 확대될 것이라고 예측했다.

핵심은 두뇌의 언어 중추와 유사한 LLM을 통해 로봇이 인간의 지시를 더 자연스럽게 이해하고 반응할 것이라는 점이다.

이러한 기계는 인간으로부터, 서로 간에, 그리고 주변 환경으로부터 지속적으로 학습할 수 있게 된다.

탈라는 "이러한 속성을 고려할 때 생성형 AI는 로보틱스에 아주 적합하다"라고 설명했다.

로봇의 생성형 AI 활용 방법

어질리티 로보틱스(Agility Robotics)나 NTT와 같은 기업들은 로봇의 텍스트나 음성 명령을 이해를 위해 생성형 AI를 로봇에 통합하고 있다. 드리미 테크놀로지(Dreame Technology)의 로봇 청소기는 생성형 AI 모델이 만든 시뮬레이션 생활 공간에서 훈련을 받고 있다. 일렉트릭 쉽(Electric Sheep)은 자율 잔디 깎기를 위한 월드 모델(world model)을 개발 중이다.

엔비디아는 엔비디아 아이작(Isaac)이나 젯슨(Jetson) 플랫폼 등 AI 기반 로봇의 개발과 배포를 원활하게 하는 기술을 보유하고 있으며, 120만 명 이상의 개발자와 1만 명 이상의 고객 및 파트너가 이러한 기술을 활용하고 있다.

아날로그 디바이스(Analog Devices), 오로라 랩스(Aurora Labs), 캐노니컬(Canonical), 드리미 이노베이션 테크놀로지(Dreame Innovation Technology), 드라이브유(DriveU), 이콘 시스템즈(e-con Systems), 에코트론(Ecotron), 인챈티드 툴스(Enchanted Tools), 글룩스킨트(GluxKind), 허사이 테크놀로지(Hesai Technology), 레오파드 이미징(Leopard Imaging), 세그웨이-나인봇(Segway-Ninebot), 노다(Nodar), 오르벡(Orbbec), Qt 그룹(Qt Group), 로보센스(Robosense), 스파르탄 레이더(Spartan Radar), TDK 코퍼레이션(TDK Corporation), 텔릿(Telit), 유니트리 로보틱스, 보이언트 포토닉스(Voyant Photonics), 지비전 테크놀로지(ZVISION Technologies Co., Ltd)을 포함해 많은 업체가 이번 CES 2024에 참여한다.

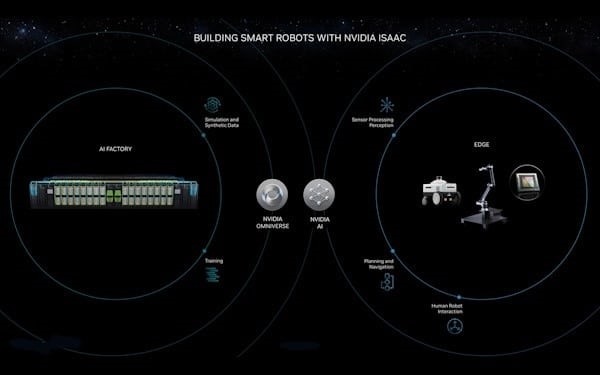

듀얼 컴퓨터 모델로 강력한 기능 지원

탈라는 CES 강연에서 로보틱스에 AI를 배포하는 데 필수적인 듀얼 컴퓨터 모델을 선보이며 AI 개발과 적용에 대한 엔비디아의 포괄적인 접근방식을 설명했다.

"AI 팩토리"라고 불리는 첫 번째 컴퓨터는 AI 모델 생성과 지속적인 개선에 핵심적인 역할을 한다.

AI 팩토리는 AI 기술은 물론 AI 모델 시뮬레이션과 훈련을 위한 엔비디아 옴니버스(Omniverse) 플랫폼과 함께 엔비디아 데이터센터 컴퓨팅 인프라를 사용한다.

두 번째 컴퓨터는 로봇의 런타임 환경(runtime environment)을 제공한다.

이는 애플리케이션에 따라 다양하게 사용될 수 있다. 예를 들어 클라우드나 데이터센터, 반도체 제조의 결함 검사와 같은 작업을 위한 온프레미스 서버, 여러 센서와 카메라가 장착된 자율 머신 내부 등에 탑재 가능하다.

고품질 애셋과 장면(scene) 생성

탈라는 LLM이 기술 장벽을 허물고 있음을 강조했다. 이를 통해 일반 사용자도 전문 아티스트처럼 복잡한 로보틱스 워크셀이나 전체 웨어하우스 시뮬레이션을 제작할 수 있다는 것이다.

피카소(Picasso)와 같은 생성형 AI 툴을 사용하면 간단한 텍스트 프롬프트에서 사실적인 3D 애셋을 생성하고, 이를 디지털 장면에 추가해 역동적이고 포괄적인 로봇 훈련 환경을 구축할 수 있다.

더불어 이와 동일한 기능을 사용해 옴니버스에서 다양하고 물리적으로 정확한 시나리오를 생성할 수 있어 로봇의 테스트와 훈련을 향상시킴으로써 실질적인 사용이 가능하도록 보장한다.

또한 로봇 배치를 재구성하는 작업에도 생성형 AI의 혁신적인 기술이 적합하게 쓰일 수 있다.

일반적으로, 로봇은 지정 작업에 특화된 방식으로 제작돼 왔기 때문에 다른 작업을 위해 로봇을 조정하는 데는 많은 시간이 소요됐다. 하지만 LLM과 비전 언어 모델이 발전됨에 따라 이러한 병목 현상이 없어지고 자연어(natural language)를 통해 로봇과 보다 직관적인 상호 작용이 가능해졌다고 탈라는 설명했다.

주변 환경을 인식하고 그에 적응할 수 있는 이러한 기계가 전 세계로 확산될 날이 이제 머지않았다.

여기에서 가상 CES 세션에 참여해 탈라의 강연 전문을 시청할 수 있다.