GTC | 시뮬레이션부터 실제 적용까지, 엔비디아 AI 기반 로봇 개발 전 과정 공개

엔비디아(www.nvidia.co.kr)가 미국 새너제이에서 열린 세계 최대 AI·가속 컴퓨팅 콘퍼런스인 ‘엔비디아(NVIDIA) GTC 2026’에서 차세대 로보틱스 개발을 위한 피지컬 AI 플랫폼을 공개하며, 전문가형 범용(generalist-specialist) 로봇 시대를 위한 비전을 제시했다고 밝혔다.

차세대 로봇은 전문가형 범용으로 진화할 전망이다. 이는 다양한 지시를 이해하고 광범위한 기술을 습득하는 동시에, 특정 작업에 대해서도 훈련이 가능한 로봇이다.

즉, 전문가형 범용 로봇은 여러 분야를 두루 다루면서도, 특정 업무를 완벽하게 수행할 수 있다.

이러한 로봇 개발을 위해서는 데이터 수집·생성부터 제어 정책의 훈련·평가, 물리적 장비에 안전한 배포를 가능하게 하는 클라우드 투 로봇(cloud-to-robot) 통합 워크플로우가 필요하다. 전문가형 범용 시스템은 다양한 작업 환경에서 인식, 이해, 행동을 지능적으로 수행하기 위해 추론 기반 비전 언어 행동(vision language action, VLA) 모델에 의존한다.

이러한 전환을 가속화하기 위해, 오픈 엔비디아 아이작(Isaac) 플랫폼은 로보틱스 개발자들에게 필요한 모델, 데이터 파이프라인, 시뮬레이션 프레임워크, 런타임 라이브러리 등 모든 요소를 제공한다. 또한 엔비디아의 3-컴퓨터 솔루션(three-computer solution)을 통해 로봇을 구축하고 대규모로 배포할 수 있도록 지원한다. 엔비디아는 오픈 VLA 모델인 엔비디아 아이작 GR00T N(Isaac GR00T N)을 제공해, 개발자들이 자체 로봇 인텔리전스를 초기화하고 사후 훈련할 수 있는 강력한 기반을 마련한다.

이러한 모델, 라이브러리, 프레임워크는 클라우드 또는 엣지 AI 인프라에서 실행할 수 있으며, 오픈클로(OpenClaw)와 같은 장기 실행 에이전트와의 통합을 통해 더욱 높은 성능을 발휘할 수 있다.

이번 주 엔비디아 GTC에서 발표된 최신 에이전트 친화형 엔비디아 아이작 GR00T 모델, 아이작 로봇 시뮬레이션과 학습 프레임워크, 엣지 AI 시스템을 통해 엔비디아는 자율 전문가형 범용 시대를 위한 강력한 개발 도구를 제공한다.

해당 워크플로우는 오픈소스로 다양한 조합을 가능하게 한다. 이를 통해 개발자는 구성 요소를 자유롭게 조합하고, 자체 도구와 데이터를 활용해 프로토타입 단계부터 실제 배포까지의 파이프라인을 가속화할 수 있다.

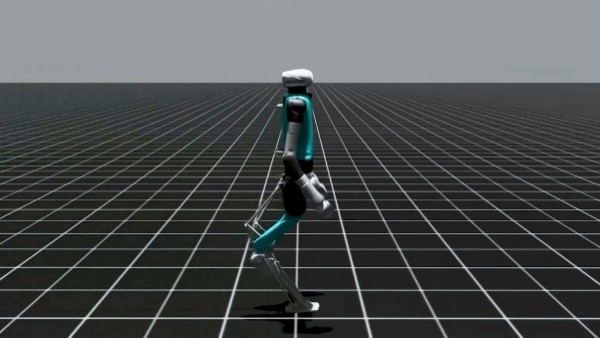

어질리티(Agility)는 엔비디아 아이작 오픈 프레임워크를 활용해 자사 로봇을 시뮬레이션 단계에서 실제 운영 단계로 전환하고 있다.

이 모든 과정은 데이터로부터 시작된다.

컴퓨팅을 데이터 전환

불과 몇 년 전만 해도 로보틱스의 파이프라인 확장은 개발자가 수동으로 데이터를 수집하는 능력에 따라 좌우됐다. 또한 로봇의 학습 능력도 다양한 시나리오와 실제 환경에 노출되는 정도에 따라 결정됐다.

엔비디아 오픈소스 라이브러리와 프레임워크는 센서 로그, 원격 조작 시연 등 실제 환경에서 수집된 신호와 시뮬레이션에서 생성된 데이터를 결합함으로써, 클라우드 컴퓨팅 자원을 활용 가능한 대규모 데이터로 신속하게 전환하는 새로운 방식을 제시한다.

로보틱스 개발자들은 물리적으로 정확한 고정밀도 합성 데이터 생성을 통해 물리적 데이터 수집의 한계를 극복할 수 있다. 특히 드물게 발생하는 극한 상황에 대한 물리적 데이터는 수집하기 어렵거나 불가능한 경우가 대부분이다. 이러한 상황은 실제 환경에서 포착하기 어렵고 위험할 수 있지만, 예측 불가능한 현실 세계에서 로봇을 대규모로 배포하기 전에 반드시 숙달해야 하는 중요한 요소다.

가트너(Gartner) 보고에 따르면, 현재 엣지 시나리오 AI 훈련 데이터 중 합성 데이터가 차지하는 비중은 20%에 불과하지만, 2030년까지 그 비중이 90% 이상으로 확대될 것으로 전망된다.

엔비디아는 물리적 세계를 기반으로 한 사실적인 합성 데이터 생성을 지원하는 라이브러리와 오픈 프레임워크를 통해 이러한 변화를 가속하고 있다.

현재 정식 출시된 엔비디아 옴니버스 누렉(Omniverse NuRec)의 가속 3D 가우시안 스플래팅(Gaussian splatting) 라이브러리는 실제 센서 데이터를 오픈소스 로봇 시뮬레이션 프레임워크인 엔비디아 아이작 심(Isaac Sim)에서 활용 가능한 오픈USD 기반의 대화형 시뮬레이션으로 변환한다. 이를 통해 개발자는 센서 데이터를 기반으로 실제 환경을 스캔하고 재현할 수 있으며, 실제 물리적 상호작용을 반영한 시뮬레이션에서 로봇을 안전하게 테스트할 수 있다.

필드AI(FieldAI)는 엔비디아 옴니버스 누렉과 자사의 선도적인 로봇 파운데이션 모델을 활용해 산업 고객들이 로보틱스와 피지컬 AI를 워크플로우에 도입할 수 있도록 지원한다.

원격 조작을 통해 다른 기기에서 실제 데이터를 가져올 수도 있다. 정식 출시된 엔비디아 아이작 텔레옵(Isaac Teleop)은 확장현실(XR) 헤드셋, 바디 트래커, 장갑 등 원격 조작 기기를 통해 수집된 데이터를 활용해, 실제 환경과 시뮬레이션 환경에서 데모 데이터를 생성할 수 있도록 지원한다. 이 데이터는 엔비디아 아이작 랩(Isaac Lab)과 같은 시뮬레이션 환경에서 로봇 훈련에 활용될 수 있다.

엔비디아 아이작 텔레옵을 통해 개발자는 실제 환경과 시뮬레이션 환경에서 데모 데이터를 원활하게 수집할 수 있다.

이러한 데이터셋은 엔비디아 피지컬 AI 데이터 팩토리 블루프린트(Physical AI Data Factory Blueprint)를 통해 확장된다. 이는 데이터 증강, 평가, 오케스트레이션을 단일 파이프라인으로 통합한다.

엔비디아 코스모스(Cosmos) 오픈 월드 파운데이션 모델과 오픈소스 에이전틱 오케스트레이터인 엔비디아 오스모(OSMO)를 기반으로, 이 레퍼런스 워크플로우는 로보틱스를 위한 확장 가능한 프로덕션 수준의 데이터 엔진을 제공한다. 이를 통해 개발자는 실제 환경에서 유사한 데이터를 수집하는 데 소요되는 시간의 극히 일부만으로, 단일 실제 시나리오를 새롭고 다양한 합성 시나리오로 전환할 수 있다.

환경과 데이터 시뮬레이션 이외에도, 로봇 개발자는 로봇 자체에 대한 시뮬레이션도 수행해야 한다. 엔비디아 아이작 심을 활용하면 휴머노이드, 자율 주행 로봇(autonomous mobile robot, AMR), 로봇 팔 등 다양한 로봇 모델을 선택할 수 있으며, 가상 모델을 실제 사양에 맞게 구현할 수 있다.

아이작 심은 PTC 온쉐이프(PTC Onshape)와 통합돼 시뮬레이션 환경에서 로봇을 구현하고 수정할 수 있도록 지원한다.

이 로봇은 오픈USD로 구현돼 생성된 데이터, 환경과 원활하게 상호작용할 수 있다. 로봇의 동작과 궤적을 기록하고 재생하며, 이를 AI 훈련 모델에 활용할 수 있다. 모든 과정은 실제 하드웨어를 사용하기 전에 시뮬레이션 환경에서 안전하게 수행된다.

AI의 실전 테스트, 정책 훈련

학습 자료인 데이터셋이 수집되면 이제 로봇이 새로운 작업을 배울 차례다. 이 과정은 GR00T와 같은 추론 VLA로 구동되는 로봇의 두뇌에서부터 시작된다.

VLA는 수행하려는 작업에 특화된 데이터를 사용해 사후 훈련을 지원한다. 예를 들어, 세탁물 접기 로봇은 옷을 집어 들고, 그 모양을 식별하며, 올바르게 접고, 이미 접힌 옷 위에 깔끔하게 쌓을 수 있도록 훈련된다. 요리 로봇은 재료를 썰고, 저으며, 볶는 데 능숙해야 하고, 병원 돌봄 로봇은 복도를 이동하고, 엘리베이터를 찾고, 의료진 또는 환자에게 물건을 건네는 방법을 배워야 한다.

로봇 팔이 라이트휠(Lightwheel) 시뮬레이션 데이터를 활용해 엔비디아 아이작 심에서 셔츠를 접는 방법을 학습한다.

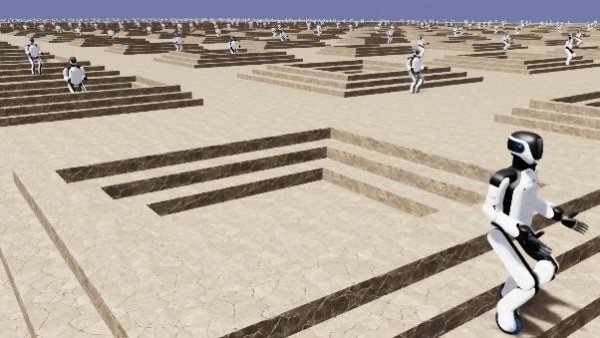

VLA 모델의 사후 훈련이 완료되면, 개발자들은 로봇 정책을 본격적으로 검증할 수 있다. 이러한 로봇을 실제 환경에서 훈련시키는 것은 시간과 비용이 많이 소요되며 위험하다. 따라서 개발자들은 최근 발표된 아이작 랩 3.0(Isaac Lab 3.0)과 같은 프레임워크를 활용해 시뮬레이션 환경에서 훈련을 진행한다. 이 프레임워크는 로봇에게 수천 개의 경량 물리 기반 시뮬레이션 환경을 병렬로 제공해, 다양한 시나리오를 동시에 안전하게 학습할 수 있도록 지원한다. 이를 통해 실제 환경에서는 수년이 걸릴 학습을 단 며칠 만에 완료할 수 있다.

헥사곤 로보틱스(Hexagon Robotics)의 휴머노이드 에이온(AEON)이 엔비디아 아이작 랩에서 계단을 오르내리는 방법을 학습하고 있다.

아이작 랩은 로봇 학습용 오픈소스 물리 엔진인 뉴턴(Newton)과 통합된다. 개발자는 뉴턴을 통해 중력, 관성 등 물리 법칙과 충돌 제약 조건을 적용하고, 물체의 움직임을 계산하는 다양한 유형의 물리 솔버를 결합해 시뮬레이션이 현실적으로 작동할 수 있도록 한다. 이를 통해 개발자는 로봇이 천과 같이 부드러운 물체와 상호작용하거나, 눈과 자갈 등의 지형을 통과하는 방식을 시뮬레이션할 수 있다.

또한 로봇 개발자들은 엔비디아 아이작 라이브러리와 AI 모델을 활용해 엣지 환경에서 런타임 배포를 최적화하고, 조작과 이동 작업의 핵심 구성 요소를 제공할 수 있다.

매니퓰레이션용 아이작(Isaac for Manipulation): 로봇이 물체를 인식하고, 기하학적 구조와 자세를 파악하며, 물체를 잡을 수 있도록 지원한다. 개발자는 이러한 인식 모델을 GPU 가속 모션 생성 기술과 결합해, 로봇이 복잡하고 지속적으로 변화하는 환경에서도 신속하게 경로를 계획하고 재설계할 수 있도록 지원한다.

모빌리티용 아이작(Isaac for Mobility): 로봇이 위치를 파악하고, 지도를 생성하며, 안전하게 이동할 수 있는 기반을 제공한다. 개발자는 GPU 가속 시각 오도메트리(odometry)와 SLAM을 활용해 안정적으로 위치를 파악하고, 실시간 3D 재구성을 결합해 장애물과 환경 변화를 회피하며 이동할 수 있다.

1X의 네오(NEO) 로봇들이 엔비디아 아이작 랩에서 다양한 지형을 가로지르는 방법을 학습하고 있다.

뉴턴은 아이작 심과 아이작 랩에서 시뮬레이션 기반 학습이 실제 환경에 효과적으로 적용될 수 있도록 지원한다. 또한 엔비디아 피직스(PhysX)와 구글 딥마인드(Google DeepMind)의 무조코(Mujoco) 등 물리 엔진도 지원한다. 이를 통해 개발자는 로봇을 별도로 조정할 필요 없이 프레임워크를 손쉽게 전환할 수 있다.

또한 단일 기술에 대한 훈련만으로는 부족하다. 개발자는 로봇의 기술이 다양한 환경과 작업에 걸쳐 적용될 수 있는지 검증해야 한다. 최근 출시된 아이작 랩-아레나(Isaac Lab-Arena)는 대규모 작업 설정과 정책 평가를 지원해, 환경 구성을 간소화하고 복잡한 작업 생성을 가속화한다. 이를 통해 개발자가 다양한 작업을 병렬로 평가할 수 있도록 돕는다. 아이작 랩-아레나는 리베로(LIBERO), 로보트윈(RoboTwin), 니스트(NIST) 등 산업·학술 벤치마크와 연결돼 개발자가 자신의 진행 상황을 편리하게 평가할 수 있다.

배포 전 반드시 거쳐야 할 테스트 단계

로봇은 실제 환경에 배포되기 전에 학습한 내용을 다양한 조건에서 반복적으로 테스트해야 한다. 로봇의 동작과 조작부터 각 작업에 대한 로봇 역학 반응까지, 모든 세부 요소가 실제 환경에서 동작하기 전에 철저히 평가돼야 한다.

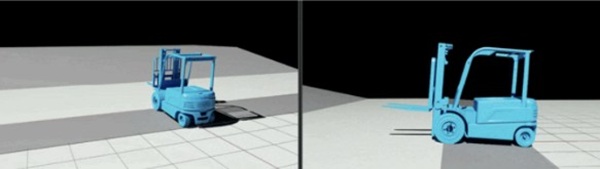

신지엔(Cyngn)은 다양한 경사면을 이동하는 지게차의 타이어 역학을 엔비디아 아이작 심에서 테스트하고 있다.

포괄적인 테스트에는 로보틱스 소프트웨어 스택을 테스트하는 ‘소프트웨어 인 더 루프(software-in-the-loop)’와, 엣지 컴퓨팅인 로봇 두뇌에서 스택이 어떻게 실행되는지를 테스트하는 ‘하드웨어 인 더 루프(hardware-in-the-loop)’가 포함된다.

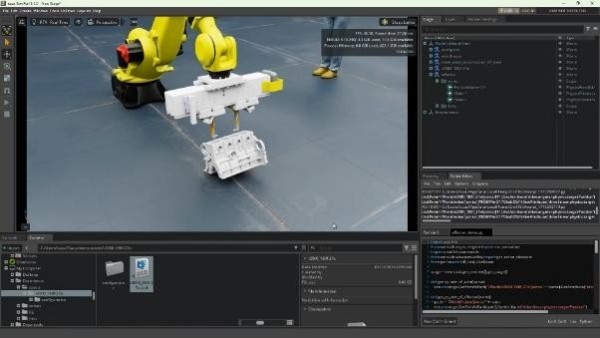

아이작 심은 하드웨어 인 더 루프와 소프트웨어 인 더 루프 테스트를 모두 지원한다. 이를 통해 개발자는 실제 환경과 시뮬레이션 환경을 쉽게 오가며 테스트하고 반복 작업을 진행할 수 있다.

반델보츠(Wandelbots)는 엔비디아 아이작 심의 고정밀도 시뮬레이션 환경에서 공장 자동화 로봇을 테스트하고 있다.

최신 버전의 아이작 심은 개발자가 다양한 워크플로우를 원활하게 전환할 수 있도록 설계됐다. 이는 누렉 렌더링을 지원해 데이터 입력을 간편하게 하며, 다양한 물리 백엔드를 통해 로봇이 아이작 심과 아이작 랩 사이를 큰 수정 없이 오갈 수 있도록 지원한다.

또한 아이작 심은 메가(Mega)와 직접 연결된다. 메가는 디지털 트윈 환경에서 피지컬 AI, 로봇 제품을 대규모로 개발, 테스트, 최적화하기 위한 엔비디아 블루프린트다. 이를 통해 로보틱스 개발자는 단일 로봇부터 수십, 수백 대의 로봇까지 테스트를 확장할 수 있다.

아이디얼웍스(Idealworks)는 엔비디아 아이작 심과 메가를 활용해 물리 기반 공장 환경에서 여러 대의 로봇을 동시에 테스트하고 있다.

엔비디아 아이작 워크플로우와 젯슨 모듈로 실제 환경에서 구현

배포 준비가 완료되면 개발자는 모델을 원활하게 실행하고, 다양한 고속 센서 데이터를 처리하며, 여러 형태와 크기의 로봇을 엣지에서 지원하기 위한 고성능 컴퓨팅이 필요하다.

젯슨 토르(Jetson Thor), 젯슨 오린(Jetson Orin)으로 구성된 엔비디아 젯슨 제품군은 소형 매니퓰레이터부터 대형 휴머노이드까지 모든 종류의 AI 로봇을 지원하며, 실시간 센싱과 AI 추론을 가능하게 한다.

애지봇(AGIBOT)과 베드록(Bedrock)은 젯슨을 기반으로 실제 환경에 맞게 설계된 로봇을 배포하고 있다.

또한 엔비디아 아이작 런타임 라이브러리는 엣지 환경에서의 로보틱스 정책 최적화를 지원한다. 최신 오픈소스 cuVSLAM 라이브러리는 젯슨 기반 임베디드 컴퓨터를 활용해 로봇이 자신의 위치를 실시간으로 파악하며, 정확하고 안정적으로 이동할 수 있게 한다.

새로운 영역의 탐구

로봇이 전문가형 범용으로 발전함에 따라, 연구자들은 기존 기능을 처음부터 다시 만들 필요 없이 쉽게 개선하고 반복할 수 있는 유연한 워크플로우가 필요해졌다.

소마-X(SOMA-X)는 엔비디아의 새로운 오픈 연구 프레임워크로, AI, 시뮬레이션, 실제 로봇 전반에서 골격, 동작, 정체성 표현을 표준화한다.

소마-X를 활용하면 리깅(rigging), 모션 리타겟팅(motion retargeting), 통합 작업을 반복적으로 수행할 필요 없이 다양한 신체 모델이나 로봇 플랫폼을 쉽게 교체할 수 있다. 이를 통해 하드웨어·소프트웨어 진화와 함께 아이작 심, 아이작 랩, GR00T 기반 파이프라인을 안정적으로 유지할 수 있다.

새로운 신체 모델, 데이터셋, 하드웨어의 등장과 함께, 개발자는 동일한 소마-X 공유 표현을 활용해 기존 도구를 유지할 수 있다. 또한 지속적으로 새로운 행동을 훈련·평가·배포하는 오픈클로 등 장기 실행 에이전트를 안정적으로 운영할 수 있다.

이 공유된 신체 레이어를 바탕으로 연구자들에게 공개된 기어-소닉(GEAR-SONIC)은 휴머노이드 로봇을 위한 강력한 기능을 제공하는 새로운 파운데이션 모델이다. 소닉은 아이작 랩의 대규모 인간 동작 데이터셋으로 훈련됐다. 여러 개의 작업별 컨트롤러 대신 단일 통합 정책을 통해 보행, 기어가기, 물체 조작 등 다양한 전신 동작을 자연스럽게 수행하도록 로봇을 훈련시킨다.

안전 도구와 시작 리소스

엔비디아의 로보틱스 스택은 안전 도구와 시작 리소스를 함께 제공해, 실험 단계에서 안정적인 대규모 시스템 배포로의 전환을 가속한다.

엔비디아 헤일로스(Halos): 클라우드부터 로봇까지 전 과정을 아우르는 엔드투엔드 안전 가드레일을 통해 안전한 로보틱스 개발, 훈련, 배포를 지원하는 풀스택 안전 시스템이다.

엔비디아 GR00T X-엠바디먼트(GR00T X-Embodiment): 엔비디아 GR00T 사후 훈련에 사용된 동일한 데이터를 포함한 데이터셋으로, 허깅페이스(Hugging Face)에서 1,000만 회 이상 다운로드됐다.

본즈-시드(BONES-SEED): 본즈 스튜디오(Bones Studio)는 14만 개의 인간 동작 애니메이션으로 구성된 휴머노이드 로봇 훈련용 대규모 라이브러리를 공개했다. 각 동작은 설명과 타임스탬프로 정밀하게 라벨링돼 있어 보다 지능적이고 사실적인 로봇을 구축하는 즉시 활용 가능한 기반을 제공한다. 본즈-시드는 허깅페이스의 엔비디아 피지컬 AI 오픈 데이터셋(Physical AI Open Dataset) 컬렉션을 통해 제공된다.

교육 리소스: 아이작 심과 아이작 랩 학습 경로가 제공돼 로보틱스 개발 입문자의 개발을 지원한다. 또한 엔비디아 DLI(Deep Learning Institute)는 자율형·강의형 강좌를 통해 로보틱스 개발 여정을 빠르게 시작할 수 있도록 돕는다.

여기에서 엔비디아 창립자 겸 CEO 젠슨 황(Jensen Huang)의 GTC 기조연설을 시청할 수 있으며, 피지컬 AI, 로보틱스, 비전 AI 세션을 살펴볼 수 있다.