IT | 성능 최대 50배↑·비용 35배↓, 엔비디아 블랙웰 울트라로 에이전틱 AI 시대 가속

엔비디아(www.nvidia.co.kr, CEO 젠슨 황)가 차세대 엔비디아 블랙웰 울트라(NVIDIA Blackwell Ultra) 플랫폼을 기반으로 에이전틱 AI 추론 성능과 비용 효율성을 대폭 향상시켰다고 밝혔다.

엔비디아 블랙웰 플랫폼이 베이스텐(Baseten), 딥인프라(DeepInfra), 파이어웍스 AI(Fireworks AI), 투게더 AI(Together AI) 등 주요 추론 서비스 제공업체들에 의해 폭넓게 도입되며 토큰당 비용을 최대 10배까지 절감하고 있다. 또한 이러한 성과를 기반으로 에이전틱 AI 분야에서도 그 영향력을 확대하고 있다.

오픈라우터(OpenRouter)의 추론 현황(State of Inference) 보고서에 따르면, AI 에이전트와 코딩 어시스턴트의 부상으로 소프트웨어 프로그래밍 관련 AI 쿼리가 지난해 11%에서 약 50%로 급증했다. 이러한 애플리케이션은 다단계 워크플로우 전반에서 실시간 반응성을 유지하기 위해 저지연성과, 전체 코드베이스를 아우르는 추론을 위한 긴 컨텍스트 처리 능력이 필요하다.

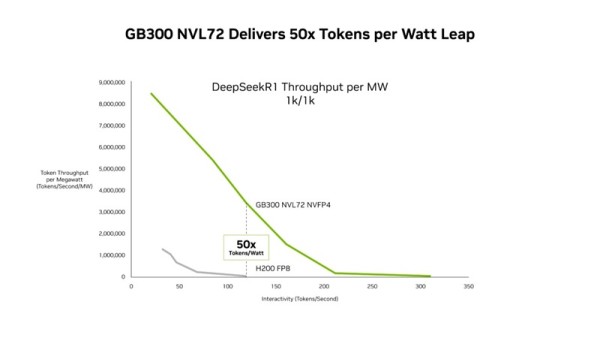

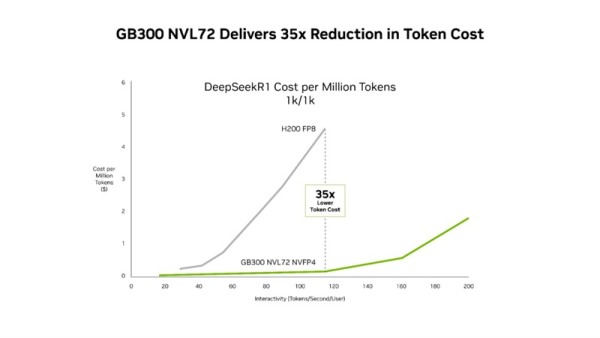

세미애널리시스 인퍼런스X(SemiAnalysis InferenceX)의 최신 성능 데이터에 따르면, 엔비디아의 소프트웨어 최적화 기술과 차세대 엔비디아 블랙웰 울트라 플랫폼의 결합이 두 영역 모두에서 획기적인 진전을 이뤄낸 것으로 나타났다. 엔비디아 GB300 NVL72 시스템은 현재 엔비디아 호퍼(Hopper) 플랫폼 대비 메가와트당 처리량을 최대 50배 향상시켰으며, 토큰당 비용은 35배까지 절감됐다.

칩, 시스템 아키텍처, 소프트웨어 전반에 걸친 혁신을 통해 엔비디아의 긴밀한 공동 설계는 성능과 비용 효율성을 동시에 끌어올리고 있다. 이는 에이전틱 코딩부터 대화형 코딩 어시스턴트에 이르기까지 다양한 AI 워크로드의 성능을 가속화하는 동시에, 대규모 환경에서 비용을 절감시킨다.

세미애널리시스 인퍼런스X는 “엔비디아는 세대가 거듭될수록 성능 향상이 뚜렷하게 나타난다. 총소유비용(TCO) 대비 성능 관점에서 볼 때, 최신 칩은 현재 추론 워크로드에 있어 최고의 성능과 경제성을 동시에 제공한다”고 밝혔다.

GB300 NVL72, 저지연 워크로드 성능 최대 50배 향상

시그널65(Signal65)의 최근 분석에 따르면, 고도화된 하드웨어, 소프트웨어 공동 설계로 구현된 엔비디아 GB200 NVL72는 엔비디아 호퍼 플랫폼 대비 와트당 토큰 처리량을 10배 이상 향상시키고, 토큰당 비용을 10분의 1 수준으로 절감했다. 이러한 대규모 성능 향상은 기반 기술 스택이 발전함에 따라 지속적으로 확대되고 있다.

엔비디아 텐서RT-LLM(TensorRT-LLM), 엔비디아 다이나모(Dynamo), 문케이크(Mooncake), SGLang 팀의 지속적인 최적화는 모든 지연 시간 구간에서 블랙웰 NVL72의 전문가 혼합(mixture-of-experts, MoE) 추론 처리량을 크게 끌어올린다. 예를 들어, GB200 기반 저지연 워크로드 성능은 엔비디아 텐서RT-LLM 라이브러리 개선을 통해 불과 4개월 전 대비 최대 5배 향상됐다.

· 고성능 GPU 커널(kernels): 효율성과 저지연을 위해 최적화됐으며, 블랙웰의 막대한 연산 성능을 극대화하며 처리량을 높인다.

· 엔비디아 NV링크 시메트릭 메모리(NVLink Symmetric Memory): GPU 간 직접 메모리 접근을 가능하게 해 더 효율적인 통신을 지원한다.

· 프로그래매틱 디펜던트 런치(Programmatic dependent launch): 이전 커널이 완전히 종료되기 전에 다음 커널의 설정 단계를 실행해 유휴 시간을 최소화한다.

이러한 소프트웨어 혁신을 기반으로, 블랙웰 울트라 GPU를 탑재한 GB300 NVL72는 호퍼 플랫폼 대비 메가와트당 처리량을 최대 50배까지 향상시킨다.

그 결과, 엔비디아 GB300은 지연 시간 전 범위에서 호퍼 플랫폼 대비 더 우수한 비용 효율성을 실현한다. 특히 에이전틱 애플리케이션이 작동하는 저지연 환경에서는 호퍼 플랫폼 대비 100만 토큰당 비용을 최대 35배까지 절감한다.

엔비디아 GB300 NVL72, 엔비디아 다이나모, 텐서RT-LLM 등으로 구성된 공동 설계 소프트웨어 스택은 엔비디아 호퍼 플랫폼 대비 토큰당 비용을 35배 절감한다.

에이전틱 코딩과 대화형 어시스턴트는 여러 단계의 워크플로우에서 밀리초(ms) 단위 지연이 누적되는 워크로드로, 지연 시간 최소화가 중요하다. 지속적인 소프트웨어 최적화와 차세대 하드웨어의 결합은 AI 플랫폼이 실시간 상호작용 경험을 더 많은 사용자에게 확장할 수 있도록 지원한다.

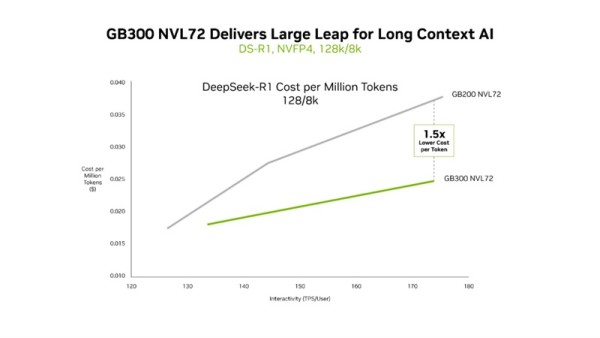

GB300 NVL72, 긴 컨텍스트 워크로드에 탁월한 비용 효율성 제공

GB200 NVL72와 GB300 NVL72 모두 효율적인 초저지연 성능을 제공하지만, GB300 NVL72의 차별화된 강점은 긴 컨텍스트 환경에서 더욱 두드러진다. 예를 들어, 코드베이스 전반을 추론하는 AI 코딩 어시스턴트 등 128,000 토큰 입력과 8,000 토큰 출력을 처리하는 워크로드의 경우, GB300 NVL72는 GB200 NVL72 대비 토큰당 비용을 최대 1.5배까지 낮춘다.

엔비디아 GB300 NVL72는 저지연, 긴 컨텍스트 워크로드에 최적화된 시스템이다.

에이전트가 더 많은 코드를 읽을수록 컨텍스트는 확장된다. 이는 코드베이스를 더 깊이 이해할 수 있게 해주지만, 훨씬 더 많은 연산을 필요로 한다. 블랙웰 울트라는 NVFP4 연산 성능이 1.5배 높고, 어텐션 처리 속도가 2배 빨라, 에이전트가 전체 코드베이스를 효율적으로 이해할 수 있도록 지원한다.

에이전틱 AI를 위한 인프라

주요 클라우드 공급업체와 AI 혁신 기업들은 이미 엔비디아 GB200 NVL72를 대규모로 도입했으며, GB300 NVL72도 프로덕션 환경에 도입하고 있다. 마이크로소프트(Microsoft), 코어위브(CoreWeave), OCI는 에이전틱 코딩과 코딩 어시스턴트 등 저지연, 긴 컨텍스트 활용 사례를 위해 GB300 NVL72를 적용하고 있다. GB300 NVL72는 토큰 비용을 절감함으로써, 대규모 코드베이스를 실시간으로 추론할 수 있는 새로운 형태의 애플리케이션을 가능하게 한다.

코어위브 엔지니어링 총괄 부사장 첸 골드버그(Chen Goldberg)는 “추론이 AI 프로덕션 환경의 핵심 요소로 부상함에 따라, 긴 컨텍스트 처리 성능과 토큰 효율성이 매우 중요해졌다. 그레이스(Grace) 블랙웰 NVL72는 이러한 도전 과제를 직접 해결한다. CKS와 SUNK를 포함한 코어위브의 AI 클라우드는 GB200의 성공을 기반으로 GB300 시스템의 개선된 성능과 비용 효율성을 예측 가능한 형태로 제공한다. 이를 통해 고객은 대규모 워크로드에서도 더 우수한 토큰 경제성과 실용적인 추론 성능을 확보할 수 있다”고 말했다.

엔비디아 베라 루빈 NVL72, 차세대 성능 혁신

엔비디아 블랙웰 시스템이 대규모로 배포되면서, 지속적인 소프트웨어 최적화를 통해 구축된 인프라 전반에서 추가적인 성능 향상과 비용 절감이 지속적으로 실현될 전망이다.

향후 선보일 엔비디아 루빈 플랫폼은 6개의 새로운 칩을 통합해 하나의 AI 슈퍼컴퓨터를 구축하며, 또 한 차례의 대규모 성능 도약을 제공할 예정이다. MoE 추론의 경우, 루빈 플랫폼은 블랙웰 대비 메가와트당 최대 10배 높은 처리량을 제공하며, 100만 토큰당 비용을 10분의 1 수준으로 낮춘다. 또한 차세대 프런티어 AI 모델의 경우, 블랙웰 대비 GPU를 4분의 1 수준으로 크게 줄여 대규모 MoE 모델을 훈련할 수 있다.

여기에서 엔비디아 루빈 플랫폼과 베라 루빈 NVL72 시스템에 대한 더 자세한 내용을 확인할 수 있다.

엔비디아, NVIDIA, 엔비디아 블랙웰 울트라, NVIDIA Blackwell Ultra, 성능, 최대, 50배↑, 비용, 35배↓, 에이전틱 AI, 시대, 가속